Things on Stage─パフォーマンス作品における開発と実践─

1.はじめに

近年のディジタル技術の進歩により,舞台やアートパフォーマンス,エンタテインメントの場においてさまざまな技術を用いた表現,演出が積極的に利用されるようになった.最も大きな変化は,映像技術の進歩によるものであり,通常の照明や音響に加え,プロジェクションや大型LEDビジョンを利用することが,特にエンタテインメントの領域においては当たり前となった.以下ではまず,舞台表現とテクノロジーの関係を振り返るとともに,筆者らの立ち位置について述べる.

舞台表現においては古くからさまざまな道具が用いられてきたが,それらは演出や装飾的な意味合いだけではなく,身体表現の拡張のために用いられたことが多い.Rudolf Laban[1]は“Labanotation”と呼ばれた新たな舞踏譜を開発したことで有名だが,正二十面体の構造体の中にダンサーを配置しその構造を利用した振り付けなどを行っている.バウハウスの中心的作家であったOskar Schlemmer[2]は身体を拡張した衣装や舞台装置を用いて前衛的な舞台作品を数多く制作している.これらの作品は今見ても新鮮さをまったく失っていない.

道具だけでなく,テクノロジーと舞台・身体表現ということに視野を広げると,Etienne-Jules Mareyの作品がやはり最初に思い当たる.写真銃(chronophotography gun)という特殊な撮影装置を用いて鳥の飛翔や人物の運動を連続写真として撮影し,それまで見ることができなかった新しい視点で人々を驚かせた.ただし,これは表現というよりは技術研究的側面の強いものであった.カナダのアニメーション・映像作家のNorman McLarenは[Pas de deux] ☆1という作品で連続撮影の手法を用いた新たな表現を開拓している.

写真,映画の時代を経て,コンピュータテクロジーが発達してくると,Merce Cunningham☆2やTroika Ranch ☆3などはそれを積極的に舞台表現に取り入れるようになる.Merce Cunninghamは早くからモーションキャプチャの技術を用いてダンサーの動きの情報から映像を生成し,それを舞台上の紗幕スクリーンに投射し,実際のダンサーの動きと映像を同時に見せる表現を試みた.また,[LifeForm] [3]というソフトウェアを導入して振り付けの生成などを行った.Troika Ranchはダンサーに筋電センサを取り付け,ダンサーの動きによって背景の映像や音をリアルタイムに操作する舞台をいち早く実現した.フランスのダンスカンパニーAdrien M & Claire Bは[Hakanaï] ☆4において,直方体の紗幕スクリーンに投影される半透明のモノクロ映像とそれに完全にリンクした振り付けによって視覚的効果の非常に高い舞台を制作した.これらテクノロジーとパフォーマンスの関係については [Digital Performance][4]に詳しいが,コンピュータテクノロジーの用いられ方はそれぞれの作品によって微妙に異なる.ただし,多くの作品に共通するのは,アウトプットが映像や音声である点である.

舞台表現に映像や音声を用いるのはその扱いやすさから当然の流れであると言える.同時に,物体や小道具などにテクノロジーを用いるのは当時は技術的に困難であったと思われ,事例は少ない.その中でも工業用ロボットアームやオリジナルの6足歩行ロボットなどを用いてパフォーマンス作品を数多く発表したStelarc ☆5は特筆すべき存在である.身体に接続されたセンサを介して特殊な舞台装置を操る様子は今日もまったく色あせることがない.

近年,ディジタルファブリケーション技術の発達により,より簡単に複雑な造形物を制作できる環境が整ってきた.また,チューリッヒ工科大学のRaffaello D’Andrea☆6に代表されるように,高度な制御技術を用いて新たなロボティクス産業を開拓していく動きも活発である.

このような歴史,時代背景の中で,筆者らの目的とすることは,映像だけでなく,舞台上に実際に存在するオブジェクトとそれらの正確な制御と動作,それに呼応する緻密な振り付けおよび演出,それらによってのみ実現できる独自の舞台作品を制作することである.モニタ上で鑑賞する映像作品と違い舞台作品においては,舞台上の人や物の存在が非常に重要であると筆者らは考えている.

以下では,過去,筆者らが制作した舞台作品での事例の中から特徴的なものを,4つのカテゴリに分けて述べる.はじめに初期の舞台作品で用いた空中移動体について述べ,次に,3次元の移動体への強い欲求で実現させた飛翔体について述べる.その後,地上移動体について述べるが,これは空中移動体でのモータ制御技術と飛翔体でのモーションキャプチャによる位置制御技術を組み合わせて実現したものである.最後にどんなものにも適用が可能である発光体について述べる.発光体の最後では,今までの知見や技術の総決算的なプロジェクトとなったリオオリンピック・パラリンピック閉会式フラッグハンドオーバーセレモニーについて述べる.

2.空中移動体

2013年に制作したパフォーマンス[pulse 3.0]☆7(図1)の冒頭のシーンで,ステッピングモータを利用した装置を制作した.舞台上には3つの黒い球体が浮いている.3人のダンサーがステージに入ってくると,ダンサーの動きに連動して球体も上下左右に動く.ダンサーが横に動くと球体もそれを追従するように横に動き,しゃがむと下がり,またあるときは球体とダンサーの動きがずれているかのように動く.人の動きに連動した舞台上を動く物体は,設計段階での想像を超えた演出的効果があった.

球体は細いワイヤーで舞台上空,上手と下手に設置されたステッピングモータに接続されていて,回転によりワイヤーの長さを変化させることで,球体の位置を制御している.原理上,3次元では移動できず,2次元(横方向と縦方向)での移動となる.6chパルス出力デバイスを制作し,USB接続で制御用のPCに接続,ボール3つ分,計6台のモータを制御している.舞台上照明バトンにはOptitrack社☆8のモーションキャプチャカメラを設置し,ダンサーの頭につけたマーカ位置のリアルタイムトラッキングを行い,頭の上方1mの位置に常に球体が来るように制御用PCにOSC(Open Sound Control)プロトコルで位置指令を送り続けている.

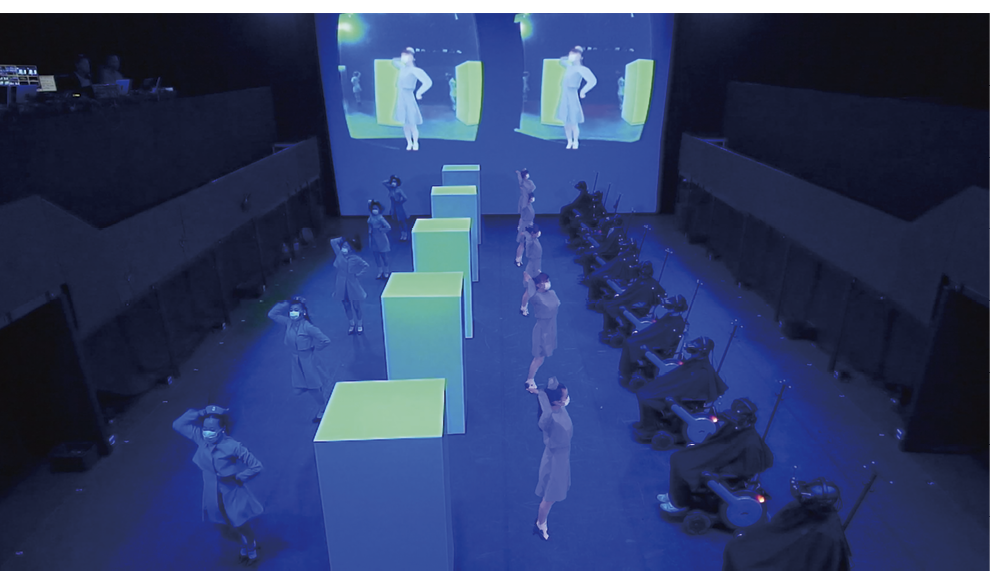

同システムを拡張し,2015年に安川電機100周年記念式典にて[motion](図2)というパフォーマンスを制作した.この作品では,合計20台のステッピングモータを利用し,舞台上空を移動する10個の立方体を演出装置として制作した.モータはアブソリュートエンコーダ搭載のものに変更し,非励磁時に立方体を手動で動かしてもモータの位置情報に狂いがなくなり,舞台上での運用性が向上した.また,立方体の表面には再帰性反射シートを貼り,赤外線カメラで立方体の位置を検出し,動くキューブオブジェクトへのリアルタイムでのプロジェクションマッピングも行っている.通常のプロジェクションマッピングは静止したオブジェクトやセットに行うことが多いが,動くオブジェクトに行うことでよりダイナミックで演出性に富む手法となっている.

舞台の上空を動くオブジェクトは,舞台空間を有効に使えるため,表現の幅を格段に広げてくれる.また,映像ではなくライブパフォーマンスの場合,目の前で人の手に触れずに空中を動くオブジェクトは非常に効果的であることが作品制作を通じて実証された.

3.飛翔体

2012年ごろから,筆者らはドローンを用いた舞台演出システムも開発を続けている.先に述べた空中移動装置は2つのモータを使っているため,物体の移動が2次元平面上に限定される.モータを3つ,あるいは4つに増やすことで物体の移動を3次元に拡張はできるが,ワイヤーなどの物理的な制約により,舞台上に1つのオブジェクトか,あるいは複数の場合も物体の移動範囲を限定せざるを得なくなる.そのような制約は演出の自由度を低くするため,制約なく舞台上を自由に3次元移動できる機器として,ドローンに着目した.

3.1 ハードウェアと制御

ドローンに限らず,新しいハードウェアを用いてシステムを新規に制作する場合,機器の選定が難しい場合が多い.ドローンの場合も,多種多様な機種が存在するが,そのほとんどは空撮用の機種でありパフォーマンスや舞台演出用に設計されたものではない.

筆者らが最初に利用したのはドイツのAscending Technologies社☆9のHummingbirdという機体である.選定の基準としては,外部指令によりリアルタイムに複数台の機体コントロールができること,ダンサーとともに動かす安全面への配慮から大きさが500mm角以内であること,照明装置や装飾を搭載する可能性が高いためその拡張がしやすいこと,といったことを重要視した.

制御は,ドローンにそれぞれ異なる配置でモーションキャプチャのマーカをとりつけトラッキングし,その位置と姿勢情報を用いてドローンの速度制御を行い,目標座標に追従するように独自の制御ソフトを開発した.ここで開発した制御ソフトはドローンのハードウェアが変わった場合も,制御のパラメータと無線通信のプロトコルを変更するだけで再利用できるような設計となっている.

2014年3月,ダンスカンパニー「Elevenplay」の公演「mosaic」にてドローンを使ったシーン[fly]☆10を制作した. Hummingbirdを3台利用し,三角錐の装飾を取り付け, 3人のダンサーと共演した.装飾については装着することにより飛行性能が落ちることは明らかだったが,演出効果を優先して取り付けている(図3).

3.2 ドローンの振り付け

本プロジェクトでは人間とドローンのコレオグラフ(振り付け)をどのように制作するべきかという点が一番の課題となった.制作当初はドローンのポジションをキーフレームで登録し,それにダンサーの動きを合わせる手法を選択したが表現に大きな制約が出てしまった.そこで,ドローンの動きもコレオグラファー(振付家)が作ることができるように,ダンサーがドローンを手に持って動いた軌跡をレコーディング,プレイバックできる仕組みを開発した.これによってダンサーとドローンのインタラクションがより細かく,濃密なものとなった.本プロジェクト以降もコレオグラファーがドローンの動きを作るためのインタフェースや独自ソフトを開発し,パフォーマンス表現の自由度を最大化するための工夫を常に行っている.

3.3 群体飛行

Hummingbirdの機体は性能は十分であったが販売価格が高価なため,たくさんの台数を演出に導入することは難しかった.ドローン演出をさらに発展させるため,より小型で安価,量産が可能なドローンの機体を使った開発を並行して進めた.

具体的には,Multiwiiベースの安価なコントローラを用い,ファームウェアをカスタマイズ,機体は3Dプリンタにより制作,Xbeeモジュールによる無線通信のプロトコルも変更し,同時に最大24台制御可能なシステムを開発した(図4).

ドローン演出の場合,ハードウェアのトラブルは事故に直結し,身体的な危害をおよぼす危険性が常に伴う.ライブパフォーマンスの失敗が許されない状況でいかにその確率を減らすか,ダンサーおよびスタッフに危険がおよばないようにするかがここでの開発の中心となった.基本的なことになるが,メンテナンスを実行する人によって個体差が出ないように手順を明確化すること,飛行前のバッテリー残量確認を確実に行うこと,小型ドローンであるため反射マーカを取り付けられる場所には制限があるが,3点の反射マーカの取り付け位置として,他の配置とできるだけ異なり,また,できるだけマーカ間の距離が遠くなるような位置を算出する独自ソフトを開発してトラッキングのエラーを減らすことなど,細かな改良を重ねて,24台のドローンと5人のダンサーによる[24 drones]☆11を発表した(図5).

3.4 飛行データの制作

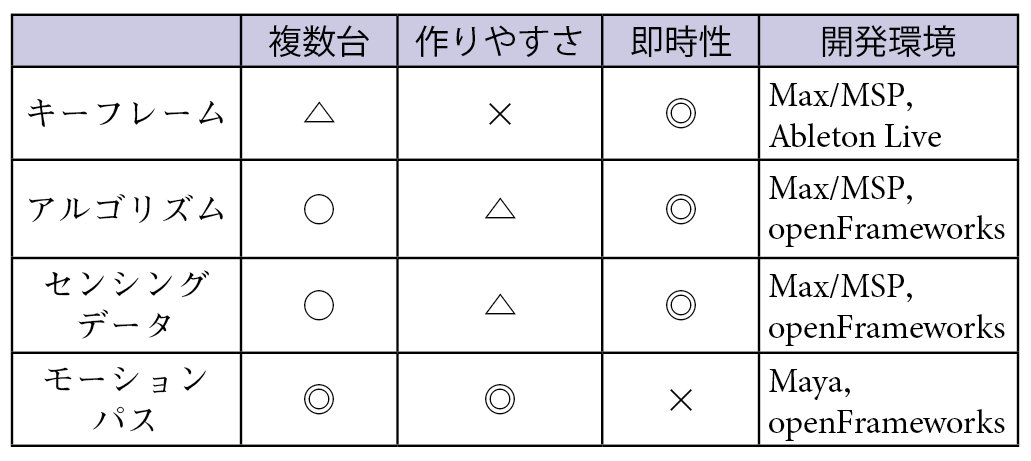

ドローンの飛行パターンの制作手法には大きく分けて4つの方法がある.制作コストを下げ,パフォーマンス表現の自由度を最大化するために制作時の環境や状況によって適切な制作手法を選択することが重要となる.現在までに筆者らが開発した制作手法として,キーフレーム方式,アルゴリズム方式,センシングデータ方式,モーションパス方式の4つがある.

キーフレーム方式は,各ドローンの動きの起点となるポイントを手動にて指定し,その間の移動は直線的な移動となる初期の方式である.アルゴリズム方式はC/C++で開発した独自ソフトを用い,複数のドローンをいくつかのアルゴリズムを用いてその位置情報を計算する方式である.たとえば,横一列に並んだドローンの高さをsin関数で決定したり,ドローンを円軌道を描くように回転させたり四角錐の面上に並べたりしている.パラメータの変更ですぐに軌道や位置の変更が反映できるのが特徴である.センシングデータ方式は,たとえばダンサーの手の位置のトラッキングデータや,加速度計や筋電センサのデータなど,何らかの外部データに連動してドローンの位置を制御する方式である.モーションパス方式は,MayaなどのCGソフトを用いて複数台のドローンの軌跡を制作していく方式である.

各方式の特徴を表1にまとめる.

あらかじめ動きのイメージがある程度明確にある場合は,モーションパス方式で動きを作り込むのが適しているが,動きの変更などの対応力が弱い.その場で動きに変更を加え効果を試しながら制作をする場合はアルゴリズム方式が適しているが,動きのバリエーションはコーディング能力に寄るところが大きくなる.パートごとに複数の方式を使い分けるなど,さまざまな工夫を行い全体のシーケンスを組み立てている.

4.地上移動体

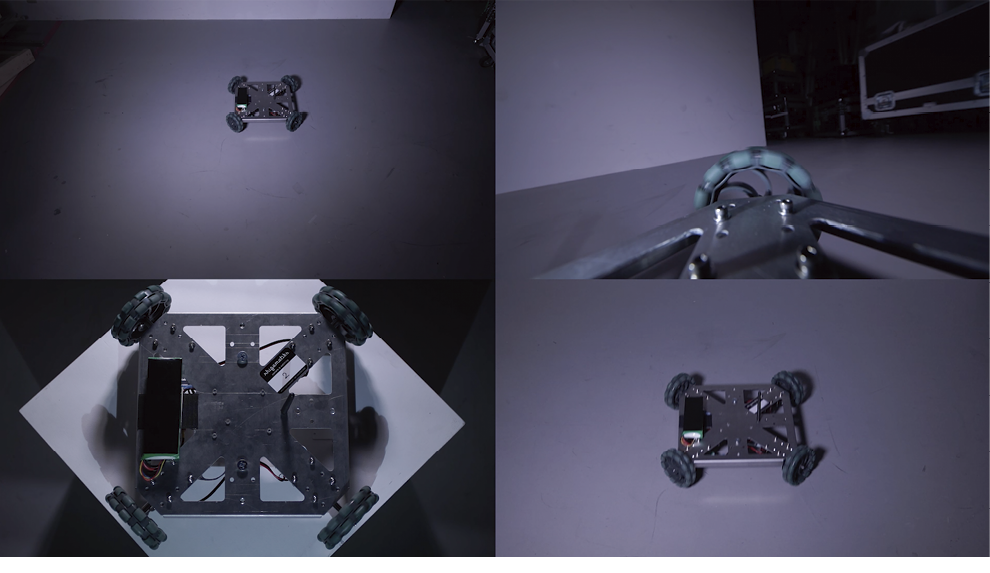

2015年12月に制作した[border]☆12は,ステージと観客席の区別をなくし,観客がダンサーとまったく同じステージ上でパフォーマンスを体験する作品である(図6).ただし観客は,ステレオカメラ付きのヘッドマウントゴーグルをかけ,制御されたパーソナルモビリティWHILL☆13に搭乗し,パフォーマンススペースを移動しながらの体験になる.ヘッドマウントディスプレイで展開される,AR/VR/MRの映像を最も効果的に見せるための舞台装置として幅900mm,奥行き900mm,高さ1,800mmの移動する直方体を制作した.舞台上での直方体の移動を考えた際,駆動輪と操舵輪による方式では,目標の位置に向かう際にどうしても進行方向を変える必要が出てしまい,動きや演出上の制約が大きい.そのため,この作品では,オムニホイールによる全方位移動台車を採用した(図7).

直方体はその移動台車の上に取り付けられており,前後左右,自由に,向きを変えることなく移動が可能なものとなった.また,WHILLも無線でコントール情報を送信し,位置制御を行っている.元々WHILLにはBluetoothによる遠隔操作の機能が備わっているが,10台同時にパフォーマンスで利用するにはやはり安定性の面で不安が残るため,WHILL社にも協力いただき,制御基板にXbeeモジュールを搭載し,Xbeeによる無線制御を採用した.また,この作品は,ヘッドマウントゴーグル,WHILL,直方体,すべてをモーションキャプチャシステムでトラッキングしている.それらを安定してトラッキングができないと,最悪の場合観客に危害が加わってしまうこともあり得るため,細心の注意を要した.変幻自在に動き回る白いボックスとダンサー,また,黒い衣装を着てWHILLに乗っている舞台装置としての観客,そのような要素があるため,観覧席から観ていてもパフォーマンス作品として成立する作品となっている.

白いボックスとWHILLの動きもドローンと同様にコレオグラファーが作ることができるように,独自のシーケンサーソフトを開発した.合成用のリアルタイムレンダリンググラフィクス,白いボックス,ダンサー,そして観客を乗せたWHILLの位置関係を考慮しながら,白いボックス,ダンサー,WHILLの動きをコレオグラファーが手探りで作ることは非常に困難であった.そのため,入力サジェスチョン機能やプレビュー機能をシーケンサーソフトに搭載し制作時の負荷を軽減した.具体的には,それぞれのオブジェクトの移動シーケンス情報から,選択しているオブジェクトが移動可能な領域を計算し表示する入力補助機能,AR映像合成のオクルージョンが発生した際に警告を出すアラート機能,観客のヘッドマウントでどのような映像を観られるかを確認できるプレビュー機能などを実装した.

[border]の移動台車は,そのモータの出力性能上,可搬重量が5キロぐらいに限定される.そこで,より重い重量物も可搬可能で,かつ,用途に応じたオブジェクトを取り付けやすいフレームを持つ汎用的な移動プラットフォームとして独自に移動台車を開発し,[distortion]☆14で利用した.この作品では,台車の上に全面鏡のボックスを取り付け,それらが5台,空間中を移動する.そこにはプロジェクションで映像が投影され,投影された映像は鏡で反射され床面に落ちるが,鏡の角度と位置に応じてあらかじめ像を変形させておくことで,床面の映像が正しく像を結ぶという作品である.可搬重量が増えることでより舞台表現の可能性が広がると思われる.今後もこの移動台車を活用していきたいと考えている.

5.発光体

ステージにおけるLEDの利用は,ディスプレイや照明など,今日では一般的である.筆者らは,市販の照明や映像装置では実現できないLEDを用いた舞台装置も,これまで数多く制作してきた.筆者らの制作するそれら装置の特徴は,小型でバッテリー内蔵,無線制御であり,そのことにより,演出や形状の自由度を飛躍的にあげることが可能となる.以下,発光体が用いられた主なプロジェクトについて述べる.

5.1 発光キューブ

2011年11月公演のElevenplay[dot.]では,内照する450mm角の乳白アクリル制のボックスを制作し,[box]☆15というシーンを制作した.ボックスの1面には円形に開口部があり,それをダンサーがかぶったり,床に置いたりしてシーンが構成されている.ダンサーが頭にかぶる必要があり,中心部に制御装置,LED素子やバッテリーを置くことができないため,それらはすべてボックスの周辺部分に収まるように設計されている.LEDの色の制御はXbeeによる無線通信で,各キューブに色情報をリアルタイムに送信している.リアルタイム送信であるため,ソフト上での色味やパターンの変更をすぐに確認できる.

5.2 ステージコスチューム

2012年4月リリースのPerfume[Spring of Life]☆16のミュージックビデオでは,当時まだあまり目にすることのなかった発光する衣装の制作を行った.楽曲の世界観に合わせた近未来的な衣装となっている.

背中から伸びるカールコードで実際に電源供給を行い,LEDのライティングパターンの制御は無線で行っている.その後,ライブパフォーマンスでもこの衣装を着用することになり,バッテリー内蔵,無線制御に再設計をし,3度,マイナーアップデートを行っている(図8).2012年のNHK紅白歌合戦では生放送という条件のため,トラブルを事前に検知できるよう,背中のコントローラデバイスに赤外線のLEDを取り付け,その明滅を舞台袖から赤外線カメラで常に監視,何か異常があった場合はその点滅で検知できるシステムを構築した.

5.3 LEDスティック

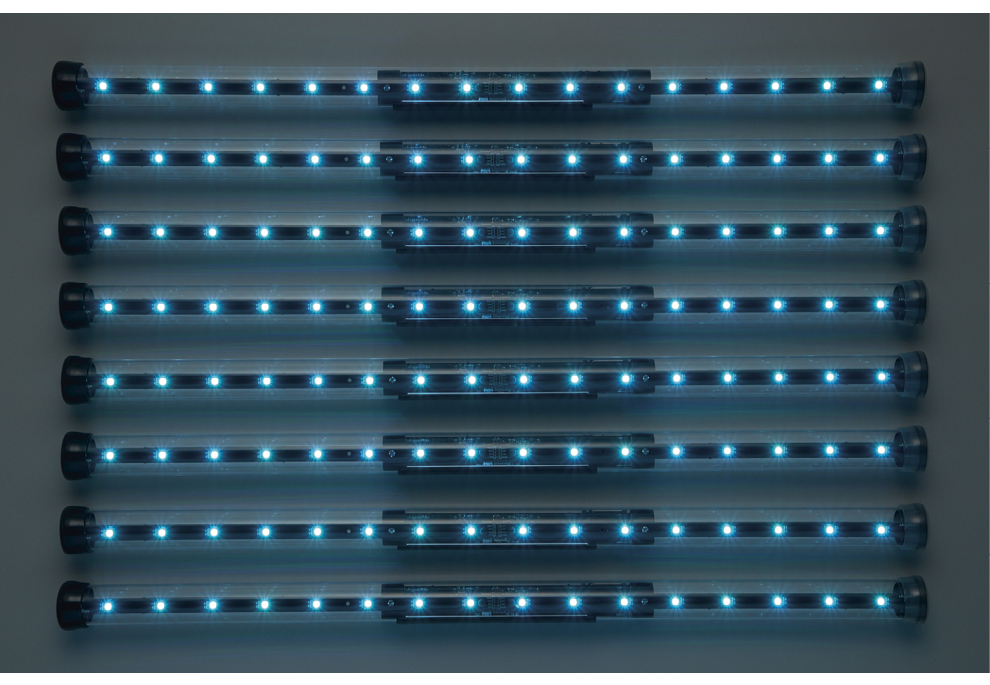

2014年6月,真駒内花火大会でのオープニング演出で,64人のダンサーの操る無線制御によるLEDデバイス(図9)を用いた[segment]☆17という作品を制作した.過去の発光体デバイスは,2.4GHz帯Xbee無線モジュールのスループット性能でもリアルタイムにデータ送信可能なデータ量であったが,この演出では1本あたり16ドットのフルカラーLEDを搭載したデバイスを128本制御する必要があり,同モジュールではスループットが足りないため,別の方式を採用した.920Mhz帯の無線モジュールを利用し,発光パターンのデータはSDカードに内蔵して,各デバイスに格納した.無線通信では,500msecごとに同期信号を送信し続け,それに応じて各デバイスではSDカードのデータから対応するタイミングの発光パターンを読み出し,LEDを発光させている.一度でも同期信号を受信すればその後はハードウェア側に内蔵したタイマーに合わせて発光パターンの再生を続ける.また,2.4GHzの帯域はほかの機器で利用が多く,ライブにおいては混線などのリスクがつきまとうが,920Mhz帯は仕様上帯域を占拠することができないため,通信トラブルの危険性も格段に低くなる.

5.4 リオオリンピック・パラリンピックフラッグハンドオーバセレモニー

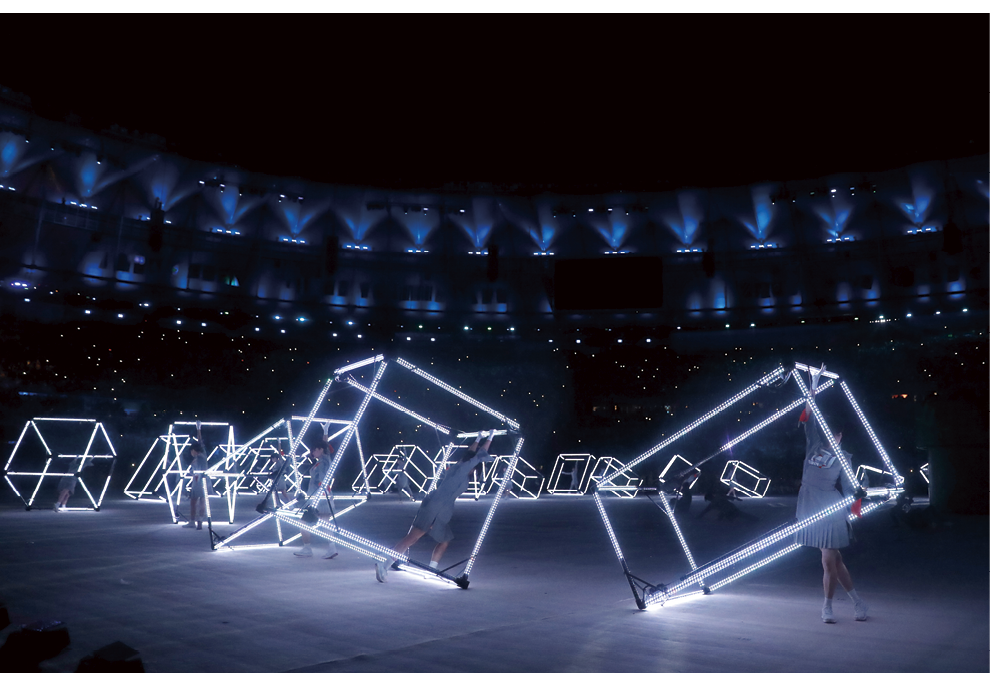

2016年8月/9月,リオオリンピック・パラリンピック,フラッグハンドオーバーセレモニーにおいて,筆者らはテクニカル演出全般を担当した.LEDフレームの設計/制作,LED手持ちライト設計/制作,LED衣装,LEDライティングデザイン,LEDおよびプロジェクションシミュレータ作成,床面投影映像制作,AR映像制作などを主に行った(図10).

5.4.1 ハードウェア

LEDフレームは,それらをダンサーが動かしながらパフォーマンスする演出上,軽量で無線制御であることが求められた.フレーム以外にも,手持ちの手具や衣装などでもLEDを内蔵したデバイスを利用する可能性があったため,制御基板は汎用性のある共通仕様で設計し,すべての装置で同じプロトコルで通信が可能,LED素子の数の変更にも対応できる設計をした.また,国内でリハーサルを行った後にリオデジャネイロに機材を輸送するため,分解/組み立てが可能な構造である必要もあった.さらに,スタジアムでのセレモニーとなるため,全方位,どこから見ても光り方が一律に見えるようにするため,フレームのパイプに対して上下左右4方向にLED素子を取り付ける設計とした.これは,前述した真駒内での反省点が活かされている.特殊な構造に対応するためLED基板も設計/制作をしている.LEDが消灯している際もステージ装置として機能するように,その外観のデザインにも気を配った.フレームは東京オリンピック・パラリンピックエンブレムのデザインに合わせて3種合計45基,手具ライト(手に持つ短い灯体)20本(図11),光る衣装20体,光る赤いボール2個を制作をした.すべて,バッテリー駆動,発光パターンをSDカードに内蔵し,920MHz帯無線で同期制御を行った.

また,無線通信でトラブルが発生した際の対応のため,各デバイスにはすべてハードウェアのプッシュスイッチを搭載し,ダンサーが楽曲に合わせて手動でライティングパターンをスタートできる設計とし,万が一無線通信が不安定なときにもデバイス類がきちんと動作するようにした.雨天でも実施予定であったため,すべてのデバイスに防水対策も施した.

SDカードにライティングパターンを格納する方式は,動作の安定性は高められるがデータの更新に時間がかかるのが難点である.特にデバイスの台数が増えれば増えるほどSDカードのデータコピー,抜き差しする手間が増大する.今後は無線通信によるライティングデータのアップデートなども実装していきたいと考えている.

5.4.2 ソフトウェア

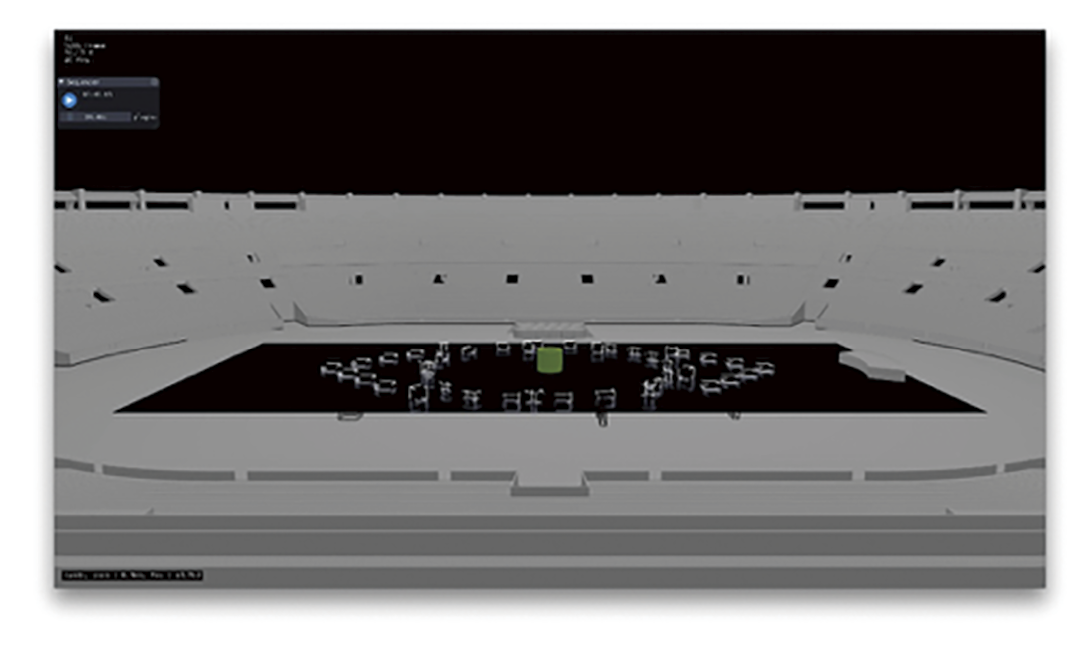

本プロジェクトでは本番会場でリハーサルができない,別会場での床面へのプロジェクションを用いたリハーサルでも運搬の制約から本番で使うLEDフレームを使用することができないなど,テクニカル面だけでなく,表現として成立するかどうかを検証できないリスクを抱えていた.

そのため,事前に床面投影映像とLEDフレーム,そしてダンサーのパフォーマンスが融合した場合にどのように見えるかを確認ができるシミュレーションソフトウェアを設計,開発する必要があった(図12).シミュレーションソフトウェアの開発は以下のような手順で行った.

1.スタジアム3Dスキャン

Faroレーザスキャナデバイスを用いてスタジアムの3Dスキャンデータを取得した.本データはARシステム,シミュレータ,映像などすべての要素で使用した.

2.シミュレーション用データ打ち込み

シミュレーション用のダンサー位置,LEDフレーム位置・回転,カメラのスイッチングを1/60秒ごとに登録できるシーケンサー,およびプレイバック機能を開発した.プレイバックは本番時に想定される20台近くのカメラのビューをレンダリング可能で,また,Oculus Rift dk2を用いて観客席からの様子もプレビューできる機能も追加した.

3.プロジェクタシミュレーション

プロジェクタを使ったリハーサルができないためフィールドに映像がプロジェクションされたときの様子を事前に確認するすべがなく,そのため,ドローンに搭載したカメラや高い場所に設置したビデオカメラのカラー映像にプロジェクション映像を合成して,さらにLEDの発光パターンを打ち込み,最終的な見た目を確認することができるシーケンサーを開発した.

4.LEDライティングデータ

本番用のLEDフレームデータを作成するための環境を制作した.LEDフレームの移動,回転データ,およびダンサーの動きのデータを利用することによって,床面投影映像とLEDフレームの光のパターンを融合することが可能となる.特に冒頭のシーンではカメラ位置と角度を利用することでLEDフレームの光のパターンが水面に反射しているかのように見える,アナモルフィックな演出も行った.これはLEDフレームを事前に作成したデータと同じスピード,位置,角度で動かさなくてはならず,技術だけでなくダンサーのスキルにも支えられた演出である.

6.おわりに

これまで筆者らが開発・実践をしてきた具体的な事例を中心にステージにおけるさまざまな装置やデバイスを総括した.4つのカテゴライズは当初から計画を立てそれに沿って進めたものでは決してなく、その時々の要望や欲求,目的に応じて開発と発表を重ねてきた結果ではあるが,技術的リソースがうまく繋がるように手法を決めている場合もある.ドローンでのモーションキャプチャ技術を移動台車の制御に応用したりしているのがその例である.

これらは,それぞれ単体で見るための技術ではなく,あくまでも舞台で人とともに動作することでその意味を持つものである.また,ここで重要なのは,技術や手法を見せることは目的ではなく,あくまでも実現したい表現・演出のためのものであるということである.こう述べると,技術自体は完成度が低くてもいいように誤解されそうであるが,そのまったく逆で,演出や表現に使えるためには,システムの安定性や確実性はインスタレーション作品などに比べて遥かに高いレベルのものが必要になる.そのために筆者らは,開発体制として,ハードウェアの開発と並行して,オブジェクトやダンサーの移動,LEDの発光パターンや投影される映像など,それらを統合的に制作,確認できるソフトウェア・シミュレータの開発をし,そこで徹底した検証を行う.ハードウェアができあがった段階ではシミュレータで制作したドローンやボックスの動き,光のパターンがそのまま実機で動く状態であるのが理想である.そしてシミュレータをさらに発展させ,舞台を演出する人(コレオグラファー)の制作環境も用意することで緻密で人と物の渾然一体となった舞台作品が制作可能になる.

特殊な表現環境になればなるほど,装置そのものだけでなくそれらを利用した演出の制作環境を整えることにもテクノロジーを最大限利用することで,その舞台環境や装置の魅力を最大限活かせる表現の場が創作できると考えている.

これからも少しでも多く,テクノロジーを用いた独自の表現・舞台作品を生み出していけるよう,追求を続けていきたいと思う.

参考文献

- 1) ルドルフ・ラバン著,日下四郎訳:ルドルフ・ラバン─新しい舞踊が生まれるまで,大修館書店(2007).

- 2) Schlemmer, O., Gropius, W., Moholy-Nagy, L., Molnár, F. and Wensinger, A. S. The theater of the Bauhaus:Oskar Schlemmer, Johns Hopkins University Press (1996).

- 3) Schiphorst, T.:A Case Study of Merce Cunningham's use of the LifeForms Computer Choreographic System in the Making of Trackers, B.G.S. Simon Fraser University (1986).

- 4) Dixon, S.:Digital Performance, The MIT Press (2007).

脚注

- ☆1 https://www.youtube.com/watch?v=WopqmACy5XI

- ☆2 https://www.mercecunningham.org/

- ☆3 http://troikaranch.org/

- ☆4 http://www.am-cb.net/projets/hakanai

- ☆5 http://stelarc.org/

- ☆6 http://raffaello.name/

- ☆7 https://www.youtube.com/watch?v=0_tVFdKDzdA

- ☆8 http://optitrack.com/

- ☆9 http://www.asctec.de/

- ☆10 https://www.youtube.com/watch?v=aTv0q14gQvY

- ☆11 https://research.rhizomatiks.com/works/agt_elevenplay.html

- ☆12 https://research.rhizomatiks.com/s/works/elevenplay_border/

- ☆13 https://whill.jp/

- ☆14 http://www.ntticc.or.jp/ja/archive/works/distortion/

- ☆15 https://www.youtube.com/watch?v=Euq0WhG_jZs

- ☆16 https://www.youtube.com/watch?v=7PtvnaEo9-0

- ☆17 https://research.rhizomatiks.com/s/works/segments/

2006年Rhizomatiks設立,2015年よりRhizomatiksの中でもR&D的要素の強いプロジェクトを行うRhizomatiks Researchを石橋素氏と共同主宰.プログラミングとインタラクションデザインを駆使してさまざまなジャンルのアーティストとコラボレーションプロジェクトを行う.米Apple社のMac誕生30周年スペシャルサイトにてジョン前田,ハンズ・ジマーを含む11人のキーパーソンのうちの1人に選出されるなど国際的な評価も高い.

石橋 素(非会員)motoi@rhizomatiks.com1975年静岡県生まれ.東京工業大学制御システム工学科,国際情報科学芸術アカデミー(IAMAS)卒業.2015年より真鍋大度とライゾマティクスのR&D・アート部門「ライゾマティクスリサーチ」を共同主宰.デバイス,ハードウェア制作を主軸にアートパフォーマンス,ミュージックビデオ,インスタレーションなど,多領域にわたり活動をしている.アルス・エレクトロニカ,カンヌライオンズ,文化庁メディア芸術祭など受賞多数.

編集担当:福島俊一(科学技術振興機構)